Autori: M. De Cecco, G. Nollo, A. Fornaser, P. Tomasin, M. Zanetti – Gruppi DII e BIOtech di AUSILIA

In medicina riabilitativa, e terapia occupazionale in particolare, lo strumento di valutazione è essenzialmente l’occhio umano e la capacità di osservare la persona durante lo svolgimento di attività della vita quotidiana così da valutarne il livello di indipendenza, efficacia, impegno, e sicurezza per poi progettare un programma riabilitativo personalizzato. Al contrario, in altri contesti clinici, la diagnostica è supportata da molti e sofisticati strumenti tecnologici come la Tomografia Assiale Computerizzata, Ecografia 3D, Risonanza Magnetica Funzionale, Tomografia ad emissione di positroni e molti altri.

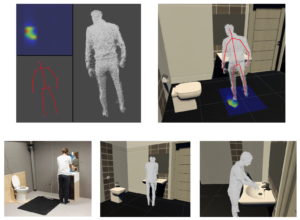

Ora è possibile colmare questa lacuna in ambito riabilitazione utilizzando tecnologie attualmente in fase di forte diffusione, attraverso le quali sarà possibile fornire al terapista occupazionale oltre che alle evidenze fornite dall’occhio umano, anche una grande quantità di dati ed informazioni quali il movimento della persona in 3D, l’interazione con l’ambiente (forze, mappe di pressione e contatto, parametri di movimento legato alla manipolazione di oggetti, etc.), oltre che ai parametri fisiologici “interni” (frequenza cardiaca, pressione sanguigna, frequenza respiratoria, sudorazione, eccetera.). Questa quantità di informazioni può essere fornita al medico in un’animazione che riproduce la realtà aumentata con tutti i parametri di cui sopra utilizzando metodologie di Realtà Aumentata.

Il principale vantaggio di questa nuova metodologia di visualizzazione del dato è duplice: gli scenari osservati sono raffigurati in animazioni contenenti tutti i parametri rilevanti, sincronizzandoli temporalmente, rappresentandoli in maniera più efficace e al contempo più contestualizzata. Ciò rappresenta una rivoluzione nel metodo della valutazione a fini riabilitativi, consentendo da un lato di aumentare l’obiettività e l’efficacia di osservazione clinica, e dall’altro di ridefinire scale di valutazione più affidabili e programmi di riabilitazione più efficaci.

Per ottenere tale risultato, la struttura implementata in AUSILIA è stata organizzata in tre elementi indipendenti in grado di condividere informazioni. Il primo elemento è l’infrastruttura di rilevamento, costituita da un insieme di sensori e tecnologie distribuite all’interno dell’appartamento. Le soluzioni di misura sono progettate per raccogliere e localmente elaborare i segnali in modo da minimizzare la quantità di dati da inviare e conservare. I collettori delle informazioni sono un insieme di PC, collocati in posizioni adeguate al fine di fornire la migliore copertura all’interno dell’ambiente e permettere una corretta connessione coi sensori. Queste unità di calcolo sono quindi collegate da una rete locale ed un router.

Secondo elemento è l’unità di raccolta dati, un server delocalizzato ed un database. Questo è collegato come master alla rete locale dell’appartamento e gestisce:

- il controllo sullo stato dell’appartamento;

- l’attivazione delle aree in riferimento allo stato / azioni / movimenti dell’utente;

- la sincronizzazione temporale di PC, dispositivi e dati;

- la raccolta dei dati e il loro trasferimento da PC verso il database.

Terzo elemento riguarda la fruizione dei dati, dove diversi supporti hardware possono essere utilizzati come supporto grafico. A seconda delle caratteristiche, tipo e potenzialità del supporto, le informazioni vengono recuperate dal database e presentate all’utente utilizzando due modalità: una interfaccia web che permette l’analisi di tutti i dati memorizzati nel database mediante una interfaccia LCD tradizionale, una interfaccia in Realtà Aumentata immersiva. Il medico può scegliere tra le due interfacce: se lo scopo è quello di concentrarsi su un singolo dato la prima interfaccia risulta ottimale; se invece lo scopo è quello di avere una visione aggregata e globale del soggetto mentre interagisce con l’ambiente circostante è preferibile la seconda.

Relativamente all’interfaccia immersiva in Realtà Aumentata, il motore ed ambiente grafico scelto è Unity. Il software è infatti ottimizzato per lo sviluppo della scena virtuale 2D / 3D ed in grado fi fornire più funzionalità rispetto a soluzioni software più standard. La configurazione identificata per il feedback in Realtà Aumentata per il clinico risulta pertanto la seguente:

- registrazione on-line i segnali dei sensori all’interno dell’ambiente domotica;

- la post-elaborazione per l’estrazione caratteristiche e la compressione dei dati;

- presentazione offline al medico tramite visore l’HTC VIVE.

L’HTC VIVE non è classificato come dispositivo di Realtà Aumentata (nel senso più stretto del termine), ma nel nostro caso si sono combinate il modello della casa domotica (quindi virtuale) con i dati dei sensori 3D (quindi reale) e diversi tipi di feedback da parte dei vari sensori collegati ambientali e degli utenti (reali), aumentando di conseguenza un dato reale ed utilizzando il virtuale come semplice supporto grafico.

A questo link un video dell’interfaccia sviluppata.